郭榮彥/聊天機器人「ChatGPT」可以取代律師嗎?

由美國OpenAI開發的大型人工智慧語言模型ChatGPT,一上線就驚豔全球。

ChatGPT除了可以回答各式問題外,還可以和他聊天、交辦任務,在智力測驗結果為83分,甚至在SAT考試中取得了1,107分,大約是美國學生中位數的水準。

因此,ChatGPT的泛用性和技術成熟度,引發了許多人對於AI取代文字工作者的討論。如同先前透過文字畫圖的AI工具,讓許多繪師感到焦慮一般,專業的文字工作者,例如律師,也不免有這樣的想像。

人工智慧如何應用在法律工作?

上一次,討論人工智慧取代法律工作者的風潮,可以回到2016年AlphaGO橫空出世;當時在圍棋界稱霸的Google人工智慧模型AlphaGo帶起了一波人工智慧取代論。

筆者記得,當時國內、外幾乎每週都可看到一篇文章,在討論最可能被AI取代的職業,而每一篇文章都可以看到律師名列其中。

當初討論有兩種聲音,一派認同,一派反對;而律師幾乎都是站在反對派,原因是因為律師的工作內容都被過度簡化。

事實上,在AlphaGO把「深度學習」這個名詞,從實驗室帶到大眾視野中不過一年,市場上陸續出現各式AI律師服務。例如受到媒體廣泛報導,由史丹佛學生創立的DoNotPay,或是中國知名法律科技公司無訟開發的AI法律顧問「法小淘」。

換句話說,就在不少人以為人工智慧只是增加點閱率的噱頭時,過去六年,人工智慧在某些法律服務的環節中,默默扮演起越來越重要的角色。

最明顯的例子,就是美國訴訟程序的e-discovery,其分類資料的流程,目前幾乎都是透過人工智慧來進行。即使在台灣,法律科技公司Lawsnote也把AI實際應用在法令遵循和契約審閱的環節,來加速律師工作的效率。

只是這些應用的場域比較專業,比起AI律師這種炫砲的名詞,沒辦法成為鎂光燈焦點,導致仍然有許多人認為AI只是譁眾取寵的標題,不會實際帶來改變;但事實上,AI對法律服務的影響已逐年提升,且非常實際地影響法律工作環節。

尤其在2019年,當遷移式學習(transferlearning1)的概念被廣泛使用後,對於如何使用AI進行文字處理,有長足的進展。

時間來到現在,大部人在使用ChatGPT後都會有非常驚艷的體驗,除了打破以往我們對人工智慧問答系統「常常牛頭不對馬嘴」的印象外,ChatGPT的泛用性比起以往體驗提升了不只一個層級。

從目前測試和觀察到的表現,ChatGPT可以處理:即時問答(提問給予答案)、連續對答(記憶前次問題,並在框架下給予回覆)還有解決任務(撰寫文章摘要、會議記錄、契約和寫程式等)。

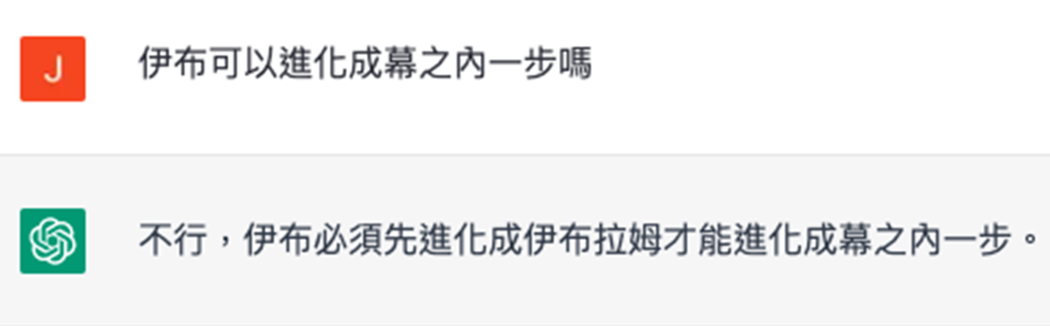

不管是什麼問題,ChatGPT都可以給出答案,但是有些時候,還是會發生一本正經的講幹話的狀況,像這樣:

根據李弘毅老師的推測,ChatGPT的訓練過程,可能是基於GPT家族的「文字生成」,加上「人類老師訓練模型」(此模型具揣測,能以人類的評分標準,為GPT的答案進行評分)而逐漸增強。

白話文說,ChatGPT做的事情,本質上就是:基於資料庫裡面文字排序的機率而定,從它拿來訓練用的資料庫,挑選裡面機率高,且符合人類偏好方式的回覆,並不是真的理解這些語言。而ChatGPT之所以可以做到這麼廣泛的回答,是因為他的參數量(1,750億)和訓練資料量(45TB)非常大。

那ChatGPT可以取代律師嗎?

目前來看,人工智慧並不會完全取代律師。雖然人工智慧在某些方面可能比律師更有優勢,例如處理大量的數據或快速搜索法律文獻,但人工智慧缺乏人類的判斷能力和分析能力,無法完全取代律師的工作。目前人工智慧更多的是為律師提供工具,以提高工作效率和質量,而不是完全取代他們。

上面這段話,是用「標題的問句」詢問ChatGPT,由AI給出的答案。由於文字的合理性和流暢度,已和人類沒有太大區別,因此擔心律師會被取代,也其來有自。

而筆者認為,目前是沒辦法的。原因有三個:

第一是輸入資訊的局限。

目前要求ChatGPT回答問題,僅限於輸入文字。文字可以是問題本身,或是問題或任務的背景資訊,而ChatGPT會依據這些資訊產出最高機率的排序。

如果輸入資訊不夠充分,背景資訊就會不足,產出資訊就會有一定機率沒辦法符合使用者實際所需的資訊。

然而,對比律師從事業務,針對一個案件或是回答問題,事先要建構的背景資訊十分複雜,並不能僅透過幾句文字描述,就能完整呈現。舉例來說,在公司內部的律師必須知道公司的各種狀態(例如競爭對手、議約權力大小、公司產品線、財務狀況、技術先進程度或是智慧財產權的狀態等),才可能審閱契約或給出法律問題的答案——這些「各種狀態」,很難在詢問ChatGPT之前,給予問題相關的背景資訊框架。

第二是訓練用資料庫的範疇。

ChatGPT現在的架構,僅能從訓練資料庫中,挑選合適的(或高機率的)答案,若是遇到答案本身不存在於訓練資料中,ChatGPT就沒辦法法學會。

對比律師實務,大部分的訴狀都是私密資料,ChatGPT可能難以學會怎麼寫一份訴狀(但可能可以寫判決)。生活經驗或從未出現過的案例,通常也不會事先存在於資料當中。因此,ChatGPT自然很難滿足,這樣需要結合不同生活經驗的律師工作。。

這也是目前ChatGPT對於常識性的問題表現不好,但專業性問題表現很好的原因。因為常識性的知識,比較不會記錄在資料當中,而是透過生活經驗來學習。同理,若是根據因果推論出來的常見資訊,ChatGPT會表現得更差。

第三是實然與應然,機率無法推理。

ChatGPT本質上還是一個機率模型,也就是挑選機率最高、最適合的文字或結果,這是基於實際發生的結果之上,是一種「實然」的表現(實際這樣發生了)。

但在法律工作中,很多時候律師是在操作一種「應然」的論述(應該這樣才對),而這些「應然」並不是透過已經發生的結果來得到的,而是透過各種邏輯推導得出的,這可能是基於機率模型的ChatGPT天生做不到的事情。

雖然這六年AI的成長令人驚艷,但離取代律師還是言之過早,正如ChatGPT自己所述,將它當作一個律師的助手或工具會來的更適合。

- 簡單來說,遷移式學習的目的,就是從過往資訊中,抽取「知識與經驗」,然後把它應用在新的目標領域當中。